脳型コンピュータに本当に必要な機能3

今回は、脳に必要な機能を、オリヴァー・サックスの著書「火星の人類学者」から考えてみます。

オリヴァー・サックスは、自閉症患者の研究をしています。

とくに記憶力や絵画、音楽など並外れた能力を持ったサヴァン症候群についての研究で有名です。

自閉症は、よく、他人の感情が理解できないと言われます。

たとえば、この本には、12歳の頭のいい自閉症の女の子のエピソードが載っています。

その子が、「ジョニーが変な音を立てています」と言うので、行ってみると、ジョニーが激しく泣いていたそうです。

その子は、泣くという意味がわからなかったようです。

このエピソードから、自閉症患者は、他人の感情が理解できないというより、そもそも、泣くという感情が理解できない、さらに言えば、泣くという感情を持っていないと言えます。

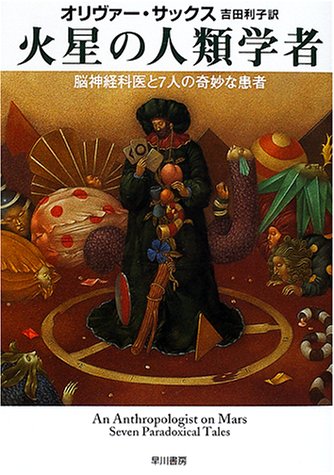

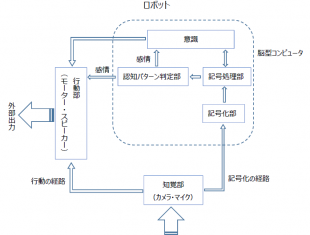

前回でも使った以下の図で説明すると、言葉(記号)は、記号処理部で処理され、認知パターン判定部で、何らかの認知パターンと判定されると、そのパターンに対応する感情が発生します。

発生した感情は、意識に出力されるとともに、行動にも表れます。

友達に悪口を言われたり、先生に怒られたりすると悲しくなります。

悲しみが大きくなり、耐えきれなくなると、目から涙が溢れ、声も出てきます。

これが「泣く」という感情です。

頭で理解するだけでなく、身体動作としても表れます。

感情は、頭と体で感じるのです。

感情が理解できないと言うことは、この「認知パターン判定部」がうまく機能していないといえます。

「泣く」という認知パターンが存在しないのです。

「泣く」という感覚を体験したことがないのです。

だから、他人が泣いているのを見ても、「変な音を出している」と、見た目の状況でしか表現できないのです。

人が言いたいこととは、最終的には、何らかの感情で表される。

これが、ロボマインド・プロジェクトの最も重要な考えです。

相手が言いたいことは、悲しいとか、楽しいといった感情で表される。

だから、感情を理解できないと、人とコミュニケーションが取れません。

自閉症患者が、人とうまくコミュニケーションが取れない理由はここにあります。

さて、「火星の人類学者」に登場するテンプル・グランディンという女性は、自閉症でありながら、動物学で博士号を取り、畜産施設経営の事業も行っている女性です。

社会的にも成功しています。

人と、普通にコミュニケーションを取れています。

では、どうやってそんなことができたのでしょうか?

彼女は、見たものをそのまま映像として記憶し、頭の中で正確に再生できる能力があります。

そこで、様々な状況で、人は、どのような行動を取るかを映像として記憶しているそうです。

人間の行動を理解するために、どんな状況だと人は怒り、どんな状況だと人は泣くのかを、ビデオに記録しているのです。

まるで自分は、火星の人類学者にでもなったようだといいます。

人間という生物は、どのような状況で、どのような感情が発生するのか、火星からじっと観察しているのです。

人と話しているとき、似たような状況のビデオはないかと常に探していて、こういう状況だと人は怒るだろうと、頭の中でビデオを再生して考えながら会話するそうです。

これは、「認知パターン判定部」の機能を、「記号処理部」に作り上げたと言えます。

「記号処理部」は、プログラムで実行されます。

「記号処理部」のプログラムは、自分で書き換えることができるので、自由にプログラムを作り直すことができます。

つまり、プログラムで認知パターンを作れるわけです。

「記号処理部」で処理した結果は、意識に出力されます。

しかし、それは、感情ではありません。

ウェイソンの4枚のカード問題で言えば、「母音の裏は偶数のはずが、奇数になっている」「間違いだ」といった、単なる計算結果です。

理屈で考えるタイプの処理です。

一方、感情で出力するとは、「未成年がお酒を飲んでいるぞ」、「悪いヤツを見つけた!」といった、正義感のような感情です。

頭で考えるのでなく、心に、自然と湧き起こるタイプの処理です。

「記号処理部」で処理した場合、感情を伴わないという違いはありますが、意識は同じ結果を受け取るので、相手が怒っているのか、悲しんでいるのか理屈で理解できます。

ただし、「記号処理部」は意識を使って考えて処理するので、時間もかかり、複雑な感情を読み取るには、かなり集中して考えないといけません。

彼女は、SFや科学の本を読むのは好きですが、人間関係が入り組んだ小説などは苦手だといいます。

人をだましたり、嫉妬したりといった感情がよくわからないといいます。

たとえば、殺人鬼が「お嬢ちゃん、かわいいランドセルだね」などと公園で遊ぶ子供に声をかけて近づくシーンを読むと、普通なら「その男についてっちゃダメ!」と思うところが、彼女は、「子供好きの優しい男なんだ」と思ったりするわけです。

見たままを解釈して、裏の意図を読み取ることができないのです。

彼女は、他の人が、相手の気持ちを読み取るのを見て、テレパシーでも使っているのではないかと思っていたそうです。

自分には、どうしてテレパシーが使えないのだろうと。

こうして見てみると、人のコミュニケーションにおいて、感情がいかに重要であるかがよくわかります。

何でもない会話であっても、自然と相手の感情を読み取っているから、会話が続くのです。

AIスピーカーに、「明日の天気を教えて」と聞けば、「残念ながら、明日は雨です」と答えてくれます。

便利ですが、それだけです。

会話が弾むことはありません。

単に、正確に質問に答えられるだけじゃ、心が通った会話は成立しません。

自閉症患者とうまくコミュニケーションが取れないのと同じです。

人とコミュニケーションできる脳型コンピュータに本当に必要な機能は、感情を理解する「認知パターン判定部」です。

感情を理解できて、はじめて、相手の言葉の真の意図が理解できるのです。

明日は楽しい運動会。

でも、足が遅くて、運動会に出たくない子供にとっては、辛い日です。

そんな子に、明日の天気を聞かれて、

「残念ながら、明日は雨です」と答えるのが正解でしょうか?

相手の感情を理解できるAIスピーカなら、

「明日は雨だから、きっと、運動会は中止になるよ。よかったね」

と答えてくれるでしょう。

これが、僕らが本当に欲しい、AIスピーカーなのです。

脳型コンピュータに本当に必要な機能1 - ウェイソンの4枚のカード問題

脳型コンピュータに本当に必要な機能1 - ウェイソンの4枚のカード問題 脳型コンピュータに本当に必要な機能2

脳型コンピュータに本当に必要な機能2 感情とは 認知パターンって何?

感情とは 認知パターンって何?