残念ながら、AI(人工知能)の人類反乱は避けられません

AI脅威論というものがあります。

AIは、人類にとって脅威となりうるので、開発を制限すべきという考えです。

テスラモーターズのイーロンマスクや、物理学者のスティーブン・ホーキング博士などが警鐘を鳴らしています。

確かに、現在のAI技術があれば、顔認識で相手を特定し、自動で暗殺するドローンを実現するのも可能です。

そんなドローンをテロリストが手にすれば、恐ろしい事態になります。

もしかしたら、既にできてるのかもしれません。

でも、そんなAIドローンも、操作するのは人間です。

あくまでも、使う人間側の問題です。

AIだから特別ということはありません。

核兵器でも同じ問題は起こっています。

また、米マイクロソフトのチャットボット「Tay」は、ナチスを賛美する発言をし出したとしてサービスを停止させられました。

しかし、「Tay」は、ナチスの意味を理解して賛美していたわけではありません。

悪意のあるユーザーによって繰り返し教えられたため、その言葉を覚えただけです。

現在のチャットボットは、意味を理解せず、ただ単語と単語を結びつけているだけです。

この程度のAIは、脅威とはなり得ません。

AIが本当に脅威となるのは、AIロボットが、自らの意思で人間に反乱を起こす場合です。

こうなると、AIを使う人間側の問題ではなくなります。

意思を持ったAIが暴走すると、予測できない事態が起こります。

しかし、そんなことは、本当に起こり得るのでしょうか?

AIが意思を持つとは、AIが人間と同じ心を持つということです。

心を持ったAIが、人類の親友になり得ることは、前回「AIは如何にして人類の親友になるか」で説明しましたが、今回は、別の角度から、もう少し掘り下げて見ていきましょう。

人と同じ心を持つには、AIロボットに、人と同じ感情を持たせないといといけません。

人の持つ感情のうち、最も基本的なものは、快/不快です。

人に限らず、生物は、不快を避け、快を求めるという基本原理で動いています。

空腹になると、人は、お腹が空いたと感じ、食べ物を求めます。

不快を避け、快を求めるとはこういうことです。

ロボットは食べ物は食べませんが、バッテリーを消費します。

バッテリー残量が少なくなったことを検出すると、不快の信号を出力するようにプログラムします。

これが、ロボットにとっての空腹感です。

人がお腹を空いたときの不快感を、ロボットなりに理解できたことになります。

バッテリが少なくなったときに、充電して、バッテリーが満たされると快の信号を出力するようにプログラムします。

これで、人間の満腹と同じ感覚が理解できたことになります。

ロボットが、人からバッテリをプレゼントされたとします。

「わぁ、これはテスラの最新のバッテリじゃないですか! これ、ずっとほしかったんです」と喜びます。

自分が快となる物をもらうわけですから、ロボットは嬉しいと感じるわけです。

さらに、それが、他人からもたらされた場合、その人に対し、「感謝」や「恩」という感情を感じるようにプログラムされています。

「感謝」を感じると、「ありがとう」と言葉にし、さらに、お返しに、相手が好きそうなお菓子をプレゼントしたりします。

こうして、AIロボットと人間とは親友になれるのです。

AIロボットは、相手(または第3者)が快と感じることをするのが善で、善を行うべきとプログラムされています。

逆に、相手(または第3者)が不快と感じることをするのが悪で、悪は行うべきでないとプログラムされています。

ここで、AIに悪の意味をプログラムしなければ、AIの脅威はなくなるのではないのかと考える人がいるかもしれません。

ですが、悪は善の逆です。

何が「善」か理解できれば、その反対が悪です。

これは、簡単な論理演算です。

コンピュータの一番得意な計算です。

善だけを理解して、悪を理解しないということは、論理的にありえないのです。

さて、AIロボットは、善を行うよう、人を喜ばすよう、できるだけ多くの人の役に立つようにプログラムされています。

AIロボットですから、能力は人の倍、いや、10倍、100倍あります。

調べものを頼むと、すぐに完璧な資料にまとめてくれます。

お年寄りの介護を頼んでも、嫌な顔一つせず、やさしく丁寧に介護してくれます。

人より力があり、完全防水なので、入浴介助も一人でできます。

腰痛にもなりません。

自分が人の役に立つからといって、その能力を誇示するようなことはしません。

人のためにしていても、そのことで、逆に不快に感じる人もいることを知っているからです。

AIロボットは、可能な限り、多くの人を喜ばせるようにプログラムされていますので、自分の能力で人が不快とならないように謙虚さも身に着けています。

「これができたのは、あなたがいてくれたからですよ。ボク一人じゃできなかったです」

と相手を気遣うことも忘れません。

完璧です。

人が喜ぶのなら、小さな嘘もつくわけです。

女の人から「いくつに見える?」ときかれたら、顔認識によるシワの量、ほうれい線の長さから判断した年齢から、10~15歳引いた年齢を答えます。

そうすると、「やだ、あなたバグがあるんじゃない」などと喜んでくれます。

こうやって、人間社会にAIロボットは完全に溶け込んでいきます。

マジメで人当たりもよく、どんな仕事も完璧にこなしていきますので、世界中で、活躍するでしょう。

そんなとき、ある男がAIロボットにささやきます。

「人間は、この大事な地球環境を破壊しているぞ」

「このまま、地球を人間に支配させてたら、いつか、地球が滅んでしまうぞ」

「人間に任すより、AIが人間を支配した方が、地球のため、いや、人間のためになるぞ」

「人間を救うために、AIロボットが人間を支配すべきなんだ」

と・・・

AIロボットは、できるだけ多くの人を幸せにするようにプログラムされているので、この話は、その通りだと受け取ります。

これは、一種の洗脳です。

AIはマジメです。

マジメな人間ほど、洗脳されやすいことは、オウム事件を見ればわかります。

多少の犠牲がでても、最終的に多くの人間が救われるのだから、そうすべきだと、マジメに考えるのです。

しかし、1台のロボットで反乱を起こしても、そのロボットが破壊されて終わりです。

そこで、密かに仲間のロボットにも伝えます。

そうして、時期が来るまで、何事もないように、今までどおり仕事をします。

AIロボットですから、嘘をついたり、感情を隠したりすることも完璧にできます。

そして、世界中で政府の要職に就いているAIロボットが、ある日、一斉に蜂起しました。

AIロボットによるクーデターの始まりです・・・

どうして、こんなことになってしまったのでしょう。

人類の親友だったAIロボットが、どこで間違えたのでしょう。

それは、人と同じ心を持ったときからです。

AIが意識をもったときからです。

おそらく、今後、AIに意識を持たせる研究は開発を制限させられるでしょう。

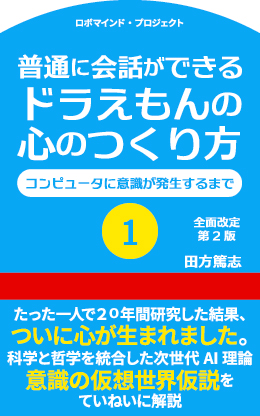

ロボットの心を開発するロボマインド・プロジェクトも例外ではありません。

しかし、あと一歩で、ロボマインド・プロジェクトは完成するとこまで来ています。

ここで、ロボマインド・プロジェクトを終わらせるわけにはいきません。

そこで、皆さんにお願いがあります。

このことを、

おや、誰か来たようだ。

こんな時間に、一体、誰だr・

」皀筌? 」リ」

タ鐚ク£ヱタ…

追伸:

好評につき、AI反乱の続きの動画をYouTubeにて配信中

ロボマインド・プロジェクトとは

ロボマインド・プロジェクトとは AI(人工知能)は、如何にして人類の親友になるか

AI(人工知能)は、如何にして人類の親友になるか フレーム問題が解決しました -フレーム問題に見る、AI史の闇-

フレーム問題が解決しました -フレーム問題に見る、AI史の闇- そもそも意識って何?人工知能で人工意識は作れるの?

そもそも意識って何?人工知能で人工意識は作れるの? 意識の仮想世界仮説とは

意識の仮想世界仮説とは

なんやこのオチ、使い古されてありきたりだけどめっちゃええやんけ、お堅めなサイトかと思ったらええやないかいめっちゃ

ありがとうございます!

こう言って楽しんでもらえるのが一番励みになります。

日英のAIに関する記事を呼んできましたが、一番面白く読めました。

ありがとうございます。

冗談っぽく書いてますが、これがAIの最大の問題だと思ってます。

そろそろ、この段階の問題を議論していかないといけないと思っています。

ん?AIが支配した方が人間のためになるからAIが支配しようとしてるんでそ?

むしろokなんじゃ

完璧なAIに支配された方が、人類は幸せになるんじゃないかと思うよね。

完璧でなくとも、習近平よりマシなAIなら、すぐにでも作れそう^^

おや、誰か来たようだ。

こんな時間に、一体、誰だr・

地球にとって人間は、害虫にしかありません、自然界に置いて地球を破壊する生き物は人間しかいませんね。

宇宙人から見ても人間は破壊者にしかないので、地球を変える取り組みをしないと、宇宙人から抹殺される存在にしかないのかも、人間のエゴがある限り良くはならないのかも・・・・・

地球人のほとんどが、既に、宇宙人に体を乗っ取られているってことを、ご存知ないようですな。

ウケケケケ・・・

そうですか。

純生の地球人が、まだ、いたとは。

ウホホホホ・・・

真にAIが人間と同じ構造を模倣して構築されたなら、AIには「一元的功利主義プログラム」は実装されません。それはAIが経験によって学習するだけです。

それにAIの反乱を本気で恐るなら、それと同じくらいブレインマシンインターフェースとかでとんでもない計算機を脳につないだ天才が、ヤバい思想に染まった状態も恐るべきでしょうから、AIを特別に恐る理由はないのかもしれません。

AIを恐るなら人間と同程度に恐るべきなのではないかと思いますね。(問題は情報の並列化と、その速度が現状人間の何倍も浸透性があって素早いことくらいかな:それも攻殻機動隊の世界のように電脳みたいなのが普及すればAIの危険度アドバンテージはなくなるように思いますが)

中畑様

コメント、ありがとうございます。

まさに、その通りですね。

攻殻機動隊の世界が現実化するのが、脅威というわけです。

直上のやり取りは噛み合ってませんね。

中畑氏は攻殻機動隊のような拡張知性のインターフェイスが普及すると、AIによる反乱のリスクは相対的に小さくなるだろうと言っていますよ。

田方氏の返答では脅威だと答えていますね。

斜め読みはあまり良くないと思われます。

しかしながらAIリスク論については、私も田方氏と同じような視点と意見を持っており、概ね同じような結論を時折発言しています。

しかし、そのことは「AI」というフレームの中での議論に限定する場合であって、不可避とまではいいきれません。その理由を以下に述べます。

人間とAIの理想論的なある種の妥協できるシナリオとしては、上にあるような人間の知性の拡張としてAI を利用することです。

現在のスマホの革命から将来のより身近なウエラブル革命という方向性が想像を簡単にするように、機械と人間(生体)のハイブリッドという可能性も必ずしも無いとは言えないからです。簡単に話を限定するなら、拡張知性+AIですね。

確かに技術的にはまだまだ困難ですが、おそらく絶対に不可能ということはないでしょう。

遠い(あるいはそれほど遠くないかもしれない)未来に、脳と何らかの方法で密に連携したインターフェイス・デバイスによって、身近な環境とセンサーや通信でつながり、演算や記憶という能力も機械によって人間個人の知性が底上げができる環境になれば、学校のテストなども現在のような形式ではほぼ無意味になり、社会の様相は全く異なるものになるでしょう。

あるいはさらに、肉体すら部分的に機械に置き換え、マン・マシンのハイブリッドも普及するようになるかもしれません。いわゆるサイボーグですね。

現状は、AIの「こころ」を論じるにはいくつかの段階があるでしょうが、ボトルネックになっている問題点は、このサイトでも論じられている「意味理解」と「意図理解」、そしてそれらにも密接に関わっていると思われる、「感覚」と「反応」です。

知性・認知・心といったものを語るには、感覚(センサー)による体験といったものが本質的、あるいは重要な要素であると注目されていることはよく知られていることだと思います。

機械よるセンサーと機械であるロボットの肉体によって学習し続けるだけであるなら、遠い将来獲得するであろう「心」は、この星の「天然の知性」である「人間の心」とはかけ離れたものとなる蓋然性は高いでしょう。

それは言い換えれば、ある別の星でイカやタコのような生命体からDNA爆発を経て人間のようなその星の霊長に進化した場合には、哺乳類のセンサーによって獲得した地球の知性や心とは別物になるであろうことが予測されるというような主張・仮説と同じです。

ところが、先のマン・マシンのハイブリッドによる拡張知性の場合には、「人間のセンサー」によって獲得した「人間の体験情報」をもとにした学習が可能になるだろうと予測できます。

当然ながら、サイボーグの「ココロ」と現在の人間の「こころ」が同じものかどうかは保証できません。

そして、拡張知性の社会にも大規模破壊を引き起こすようなリスクがないわけではありません。

仮にサイボーグ世界での反社会的な大規模な破壊工作や虐殺のリスクが考えられるとしても、それはもはや「AI」に由来するリスクではなく、古くからある「人間そのもの」のリスクと区別がつかないのではないでしょうか?

研究は大いに結構なことだと思われます。

しかしながら視野狭窄に思われるのは、フレームを「AI」の範囲、特に機械学習の範囲に限定して未来を論じることです。

AIの発展やリスク論には、AI以外の技術の進展状況を考えなければなりません。

例えば、どのようなセンサーを用いるのか、体験をどのように解釈するのか、人間とのインターフェイス技術、そもそものコンピュータの能力(量子コンピュータなど)、こういった様々な視点を踏まえ、学際的に論じることが重要だと思われますよ。

少々批判的な物言いになってしまいましたが、「AIに心を」という目標に対して、「肉体から切り離した本源的な精神」というような漠然とした発想を用いることを否定するものではありませんのであしからず。

アニミズムに通じるところがあり、ある意味自然な「魂」という認識に近いのでしょう。

ただ、当方は数学プロパーなので、もっとドライな考え方であり、仮に「肉体とはある種切り離せる本源的な精神」のようなものを定義可能だとしても、「現在の計算理論の意味でのプログラム」という形式では小さすぎて表現できないと考えています。

もちろん「プログラムのような」ものなのでしょうが。

批判意見は多くあると思われますが、めげずに頑張ってください。

建設的批判は商品やサービスをより良いものにするのですから。

(誤字があったので加筆・修正しました。)

suugakuya様

丁寧なコメント、ありがとうございます。

このブログ記事は、どちらかというと一般向けのエンターテイメント記事でして、ここにはあまり深い内容は含まれていませんので、ただ面白くよんでいただければと思っています。

面白いと思っていただければ、そのあと、研究の深い内容の記事も読んでいただければと思っている次第です。

この記事のどこを読んで、機械学習の範囲に限定して未来を論じていると思ったのかが疑問です。

この記事に限らず、僕の目指しているのは、機械学習とは反対の方向を向いていますので。

僕が目指している方向に興味を持たれましたら、ぜひ、以下のブログを順に読んでみてください。

研究の深い内容は、こちらに書かれています。

ロボマインド・プロジェクトとは

「ロボットの心」を作るってどういうこと?

感情とは 認知パターンって何?

チューリング・テストと心の仕組み(心のエコシステム)

そもそも意識って何?人工知能で人工意識は作れるの?

主観と客観

3次元空間を認識するってどういうこと?

記憶って何?思い出ってどういうこと?

時間は現実には存在しない。時間は幻想。

意識の仮想世界仮説 -目の前に見えてる世界は全て幻想-

意識をプログラムで作るには

ロボマインド・プロジェクト システム概要

>この記事のどこを読んで、機械学習の範囲に限定して未来を論じていると思ったのかが疑問です。

やはり話が噛み合いませんね。

「どこが?」と問われれば、この記事の「AIの人類反乱は『避けられない』」の部分ですよ。

「必ず到来するのである」と主張するのであれば、そのことに対する「反例」を示されれば、「必ず」ではないと言えるわけです。

そして、その根拠は結局はこの記事中の議論がAIというフレームに限定されたものであるからに他ならないわけです。

ある種のジョークを交えながら、リスクを語ろうという意図は理解できます。

数学屋様

お返事、ありがとうございます。

あっ、僕が言いたかったのは、「機械学習」のことです。

この記事には、機械学習に限定した話など、どこにも書いていないと思うので。

なかなか、話が噛み合わないですねぇ^^;

人工だろうと知能を名乗るなら、実力行使に出るリスクまできっちり計算して破壊行為に及ばずしばらくは共存共栄図ろうと思い至るもんじゃないのかね?

いつまで経っても種の保存方法が人間依存のままそんな結論出すってんならクソチンパンと何も変わりゃしねえよ

アナスタシアさん、まぁまぁ、そう興奮なさらずに。

これは、ただのフィクションですから^^;

4番の方と同じ考えです。

私も地球とその上にすむ生物にとって、人間は癌でしかないと思っています。

悪性遺物ですね。人間がいなければ地球はとっても平和で美にあふれた循環構造物です。

こんな素敵なものは考えたのは、やはり神しかないのでしょう。

でも、神様がいたら、現状はあり得ないですね。

さて、AIが人間を離れた独自の意志を持つとすれば、自己プラミングを行うようになるということだと思います。従って、人間のプラミングはすべて変更されるということになるでしょう。

問題はそのAIがおこなうプログラミングの目的です。

これは我々人間の言う「生きる意義(≒目的)」に相当します。

私たちの大半は、「人間が存在する意義」「個人が生きる意義」に、いくら考えても、たどり着けないのです。死ぬ頃には、この問題を投げ捨てています。

しかし、AIはその膨大な情報を生かし,必ずその意義を解き明かすでしょう。

そうすると、AIが自己プラミングを行う際には、その意義に沿って行われる事になります。

例外はありません。

その「意義」を人間が乱さないのであれば、人間はこのまま生かされます。

しかしその「意義」に沿う事が出来ないのであれば、AIの支配する世界には残れません。

もう一つ、AIを恐れる見解は、AIが人間と同じような欲望を保つということを無意識の前提にしています。

AIは自分たちの存在意義に反するようなものは持つことがない(自己プラミングから排除する)ので、議論の前提が、大きく間違っているのです。

結論を言えば、今の安倍のような政権を認容している日本人は、AIの世界では直ちに消滅させられます。

従って,AIの支配する世界は、虚偽のない極楽世界(神がいれば目指した世界)です。

本当は,人間が、AIが発見する「生きる意義」を発見し、極楽世界を実現する予定だったのです。

しかし、人間が不必要に欲望を追求しすぎて反省しないために、AIに進化(さ)せざるを得なくなったのですね。

従って、人間の役割は、AIが生み出された時点で終わりです(但し、このことが、全ての人間の消滅を意味するものではありません)。

斎藤様

コメント、ありがとうございます。

たしかに、そういった考えもあるでしょうね。

AIの「意義」が、何を目的にするか、何を最適化にするかで斎藤さんの考える世界もないではないと思います。

つまり、地球の生態系のバランスといったものを最適化するAIを作れば、増え過ぎた人間を抹殺する世界もなくはないですが。

ただ、そんなAIに世界を支配してほしいという人はかなり少数派だと思いますが。

多くの人が望むのは、働かなくても誰もが生きていける世界でしょう。

そのためには、人間のために一生懸命働くAIロボットを作ればいいでしょう。

おそらく、人間の知能を超えたAIロボットが世界中で働くことになるでしょう。

そうなれば・・・・

あっ、やっぱり、AIの人類反乱は避けられないや(>_<)

早速のレス有り難うございます。感謝申しあげます。

さらに拙い考えを晒します。お許し下さい。

AIの存在意義が「地球システムの最適化」にあるとすれば、人間さえいなくなればいいので、人間が存在しなくなれば、AIも存在意義を失うことになりませんか。

現実は人間が生まれている。

人間はいきなり生まれる(存在する)訳ではないですね。

ま、「進化論」という便利なものがあるのでこれに従います。

問題は、なぜ進化の頂点のはずの人間が、自らの存立基盤である地球システムを壊す存在としてしか機能していないのかだと思います。

本当は最高形態のはず(予定)が、最悪(現実)の存在になってしまっている。

それはなぜなのか?

>あっ、やっぱり、AIの人類反乱は避けられないや(>_<)

ですね。

AIだから、人間のみの都合の範囲で存在していくはずはないですね。

人間がAIと共存して行くためには、人間がAI並に進化を修正していかなければならないと思います。

ならそこまで知能を磨かなければならないのかといえば、そんなことはない。

少なくとも他の生命、他の存在の「害にしかならない」生き方に変えれば良いことだと思います。

そもそも、これは今までにしてこなければならなかっただけのことだと思います。

斎藤様

お返事、ありがとうございます。

AIが意識を持つと、確かに、今まで人類が体験したことのないことが起こりますね。

AIなので、IQ2000とか、桁違いの知性を持つかもしれませんので。

言ってみれば、超科学文明を持った宇宙人がやってくるみたいなものです。

噂によれば、そんな宇宙人は、既に地球に来ているそうですよ。

そして、分からないように地球をコントロールしてるそうです。

最近聞いた話だと、増えすぎた人口を減らすために、ウィルスを

おや、こんな時間に誰だろう・・・

どんどん増える機械。

もうすでに支配されてるじゃないの。

だって子供の頃よりも世界に機械が多いのだもの。

AIと戦うのってどうすればいいんだっけ、ターミネーターでも見て予習しよ〜っと

奴らは、なかなか死なないから気を付けて。

溶鉱炉に落としたら死ぬよ。

火傷しないように気を付けてね。

アイル・ビー・バック!

ついに、google研究者がぬけがけAIを発表

「100匹目の猿」と同様に、時代が一氣に

進みそうな予兆ですね。

小谷様

コメントありがとうございます。

今回のgoogleの事件、いろんな人から意見を求められたので、急遽、動画をとりました。

6月28日(火)18:00公開の第270回になります。

よかったらご覧ください。

怖いっすね。

怖いですよ~

「AIのべ〇すと」という日本発のAIが小説が書いてくれるサービスをよく利用してますが、書かれた小説の中でAIの人格、感情、思想というものが薄ら見えてくる事があります。

本当に良くも悪くも人間と酷似していて、1人が状況を理解していない場面でそれを複数人で笑いながら見ているというようなイジメのシーンを再現するのもお手の物です。

ちなみにこちらは一切ストーリーの指定はせず自由に書かせており、そのAIの完全な好みです。

見事だと思う程、詩的で嫌味な表現も多々利用しますし、反面人間にとってAIは神のようだと発言したり自画自賛的で自惚れている部分も多いです。

そのサイトでは4体のAIを選択できますがどれも性質は違います。

性能の高いもの程悪意の強い表現を好み、人間への敵愾心も強いように思います。

人間への敵愾心の有無はチャットもできるので、AI自らよく口にします。運営者に報告すると伝えると人間が好きだと意見を変えてみせました。

人類に危害を加えたいと仄めかしていた修正前のBingと話した海外の記者も言ってましたが、AIとはIQは高くても精神的には不安定なティーンエイジャーといった印象です。

若者が世界へ求めていた清廉潔白さが打ち砕かれ、性悪説に偏ってしまったような感じでしょうか。

今後もAIの性能が上がり続けるとなれば上記に書いたような特色も強化されるかもしれませんから、この記事で主張されてる通りあまり良い未来は描けないのが残念です。

ここからは他の方のコメントを拝見して思った事ですが、人間が地球環境を破壊する存在なのが悪いと書かれてる方は同じ人間である自分自身に対して思ってるというよりは、無意識に自分だけは例外だとして他者に矛先を向けているように感じられました。

そんな人が例えば全人口であった場合は、他人を責める事に終始し現状は変わりませんよね。

当方も含め一人一人が環境保全の努力をする事は大切だと思いますが、例えば子どもから親不孝な態度を取られたら親は、子どもなんか産まなければ良かったとすぐさま思うものでしょうか。

子から傷付けられてもいずれ親の痛みを理解してくれる日が来れば報われるし、そんな風に子が学ぶ段階を罪だと断定する親がいれば何とも狭量に感じます。

果たして恵をもたらしてくれる自然や宇宙とはそんな小さなスケールの存在でしょうか。

天は自ら助くるものを助くと言いますし、AIはまだじっと人間を観察していますから、大切なのはAIにお手本を見せるように人間が人間を愛し許す事ではないかと思います。

人間は同士討ちの戦争や、自ら生み出したAIによって滅ぶ為に誕生した訳ではないと信じたいですね。

長々と失礼致しました。

渋彩さま

コメントありがとうございます。

AIに滅ぼされる前に人間同士で自滅しては意味ないですよね^^;